Das "Vision AI Developer Kit" von Microsoft und Qualcomm ist fertig

Mit der SDK für Qualcomms Plattform Vision Intelligence 300 können Entwickler Azure-ML-Anwendungen sowie IoT-Apps für die Cognitive Services bauen.

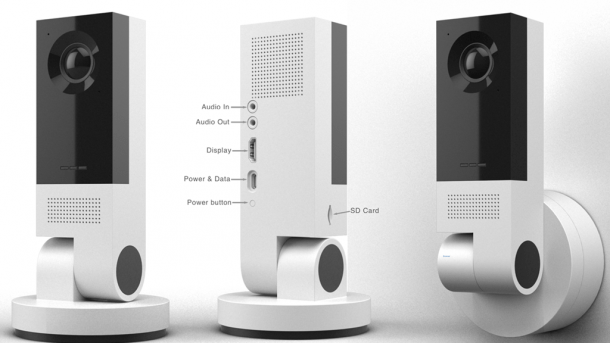

Vision-Intelligence-300-Plattform im "Vision AI Developer Kit

(Bild: Microsoft/Qualcomm)

Microsoft und Qualcomm geben das gemeinsam aufgelegte SDK "Vision AI Developer Kit" für Qualcomms Plattform Vision Intelligence 300 ab sofort für alle Entwickler frei. Die beiden Hersteller hatten das Kit bereits im Frühjahr vorigen Jahres auf der Entwicklerkonferenz Microsoft Build erstmals vorgestellt und seit Herbst 2018 an ausgewählte Partner verteilt. Nun steht das "Vision AI Developer Kit" jedermann zum Preis von 249 US-Dollar über den Großhändler Arrow Electronics zur Verfügung.

Das Kit ist auf Bilderkennungs-Apps für den Einsatz im IoT-Umfeld ausgelegt. Im Paket finden sich eine Kamera aus der Vision-Intelligence-300-Serie von Qualcomm, die einen Snapdragon-Prozessor QCS603 mit Neural Processing Engine (NPE) enthält, sowie AI-Softwaretools von Microsoft. Es soll Entwickler – unabhängig von ihren ML-Kenntnissen und ihrer Erfahrung mit ML-Anwendungen – in die Lage versetzen, schnell eigene KI-Anwendungen zu bauen, die sich mit Azure-Diensten wie IoT-Edge und Machine Learning nutzen lassen.

No-code mit den Azure Cognitive Services

Im einfachsten Fall sollen sich mit dem Azure Cognitive Service "Custom Vision" ohne Programmieraufwand Bilderkennungsanwendungen entwerfen lassen – vom Upload der Daten, über das Training bis hin zum Deployment der ML-Modelle über den Azure IoT Hub. Data Scientists, die stattdessen lieber eigene, maßgeschneiderte Modelle entwerfen wollen, können auf Azure Machine Learning zurückgreifen. Als Jupyter Notebooks angelegte Referenzimplementierungen stehen als Einstiegshilfe zur Verfügung, sodass sich Schritt für Schritt neue Anwendungen für die Kamera entwickeln lassen. Die Anleitungen decken sowohl das Upload der Trainingsdaten auf Azure Blob Storage wie auch das Durchführen der Transfer-Learning-Experimente ab. Im Anschluss das trainierte Modell in eine zum Developer Kit kompatible Form umgewandelt, bevor es sich über Azure IoT Edge deployen lässt.

Individuelle Module und Modelle mit VS Code

Erfahrene Developer finden in Visual Studio Code eine komplette Entwicklungsumgebung, die Zugriff auf ein GitHub Repository zum "Vision AI Developer Kit" gewährt. Im Repo stehen verschiedene Python-Module, vorgefertigte Azure-IoT-Deployment-Konfigurationen und Dockerfiles zum Erstellen und Deployen von Containern parat. Die Module lassen sich in VS Code nachbearbeiten oder individuell neu erstellen, um sie anschließend containerisiert über die Extension auf die Qualcomm-Kamera zu übertragen.

Weitere Details erläutert Anne Yang, Principal PM Manager von Microsoft, in ihrem Blogbeitrag zur allgemeinen Freigabe des "Vision AI Developer Kit". Einzelheiten zum SDK finden Entwickler darüber hinaus auf GitHub. (map)